Startseite

Allgemeines

Künstliche Intelligenz bei Nachrichten: Selbstbewusst daneben – aber immer freundlich dabei

Allgemeines Künstliche Intelligenz bei Nachrichten: Selbstbewusst daneben – aber immer freundlich dabei

Die RedaktionDonnerstag, 23.10.20251 Min Lesezeit295

TheDigitalArtist (CC0), Pixabay

Kategorien

Neueste Kommentare

- Petstories bei Interessengemeinschaft-tgi-ag.de-Initiative zur Aufklärung des Geschäftsmodells der TGI AG gegründet

- Petstories bei Interessengemeinschaft-tgi-ag.de-Initiative zur Aufklärung des Geschäftsmodells der TGI AG gegründet

- Anonym bei TGI AG: Wo bleibt die nachvollziehbare plausible und überzeugende Erklärung des Geschäftsmodells?

- Simone Schuhmacher bei TGI AG: Wo bleibt die nachvollziehbare plausible und überzeugende Erklärung des Geschäftsmodells?

- Moritz Müller bei TGI AG: Wo bleibt die nachvollziehbare plausible und überzeugende Erklärung des Geschäftsmodells?

Ähnliche Beiträge

Allgemeines

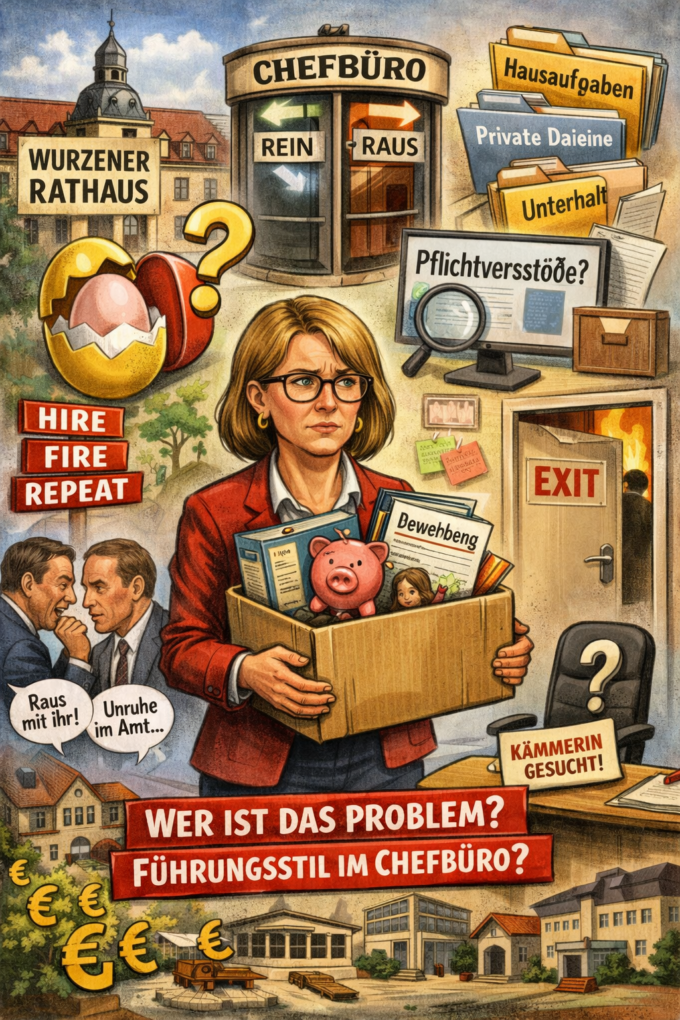

Rathaus Wurzen – oder: Die große Kündigungs-Lotterie

Im Wurzener Rathaus wird wieder einmal Personalpolitik betrieben – oder sagen wir:...

BeiDie RedaktionSamstag, 14.03.2026

Allgemeines

Hamas fordert Iran auf, Angriffe auf Golfstaaten einzustellen

Die palästinensische Organisation Hamas hat ihren wichtigsten Verbündeten Iran ungewöhnlich deutlich dazu...

BeiDie RedaktionSamstag, 14.03.2026

Allgemeines

Nachruf auf Jürgen Habermas Ein Leben für die Kraft des Arguments

Der deutsche Philosoph und Soziologe Jürgen Habermas ist tot. Wie der Suhrkamp...

BeiDie RedaktionSamstag, 14.03.2026

Allgemeines

Formel 1 entdeckt den „Unsichtbarkeits-Knopf“

In der Formel 1 gilt eigentlich: Alles wird gezeigt. Jede Überholung, jeder...

BeiDie RedaktionSamstag, 14.03.2026

Kommentar hinterlassen